MATERIALES

Una llamada de atención

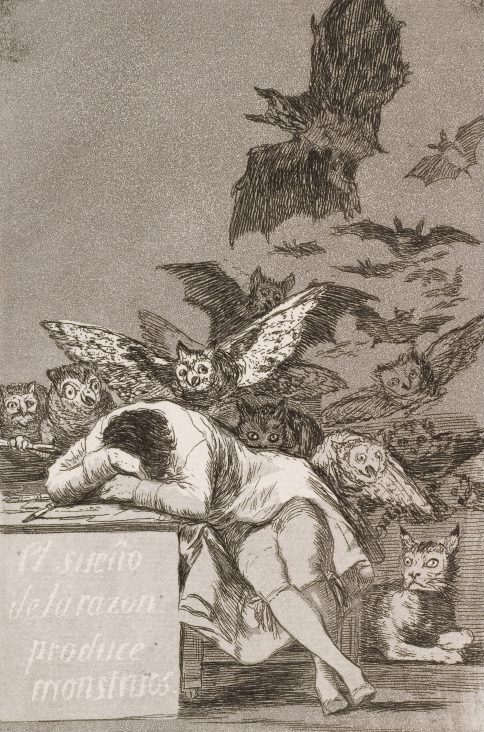

La proliferación de los grandes modelos de lenguaje en la educación superior ha sido una llamada de atención que muchas personas con experiencia en la academia preferirían ignorar. Algunas aún siguen durmiendo, dándoles la espalda y esperando que todo se detenga. Otras han despertado de golpe, alarmadas, intentando restringir su uso sin comprender realmente a qué se enfrentan.

La llamada susurra, en el fondo: «el mundo en el que creciste ya no existe».

La reacción natural —«antes todo era mejor»—, aunque recoge ansiedades legítimas, se convierte en una falacia paralizante que impide el compromiso crítico que exige este momento. Esta tendencia es especialmente seductora en los contextos académicos, en los que las metodologías establecidas gozan de peso institucional y en los que el cambio tecnológico desafía los supuestos pedagógicos más fundamentales.

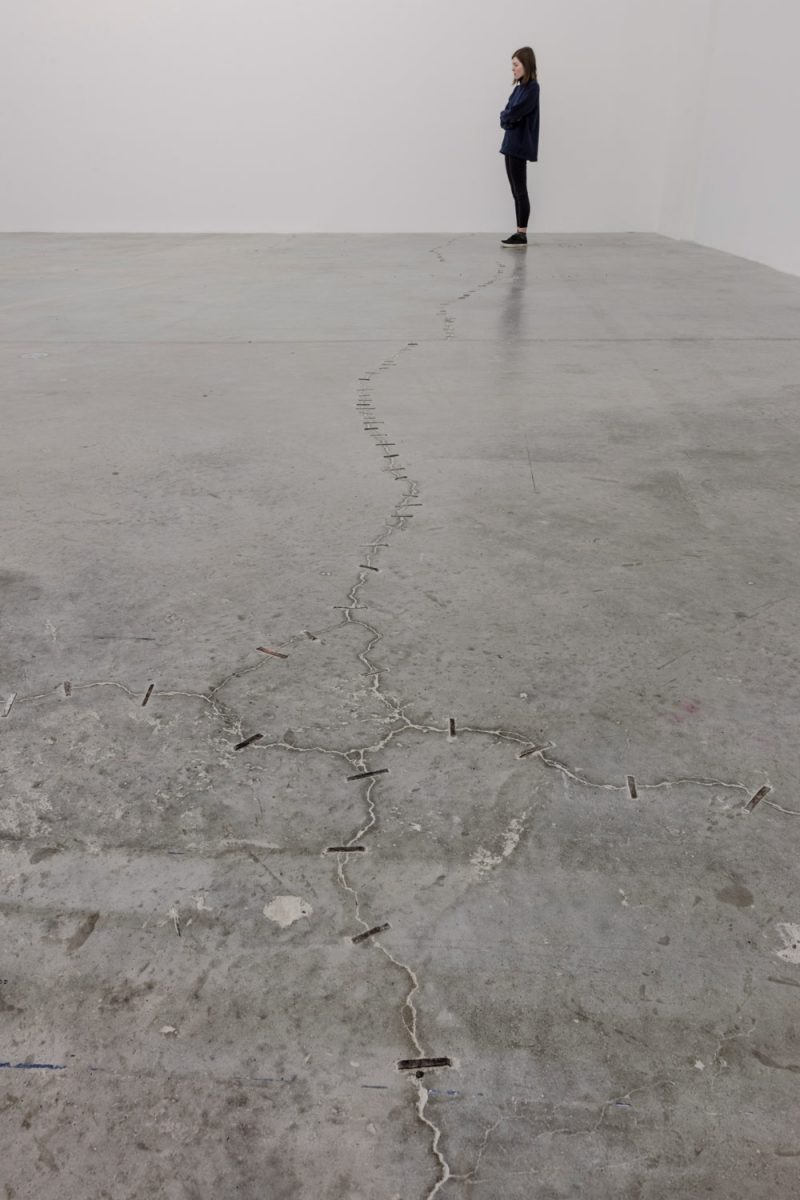

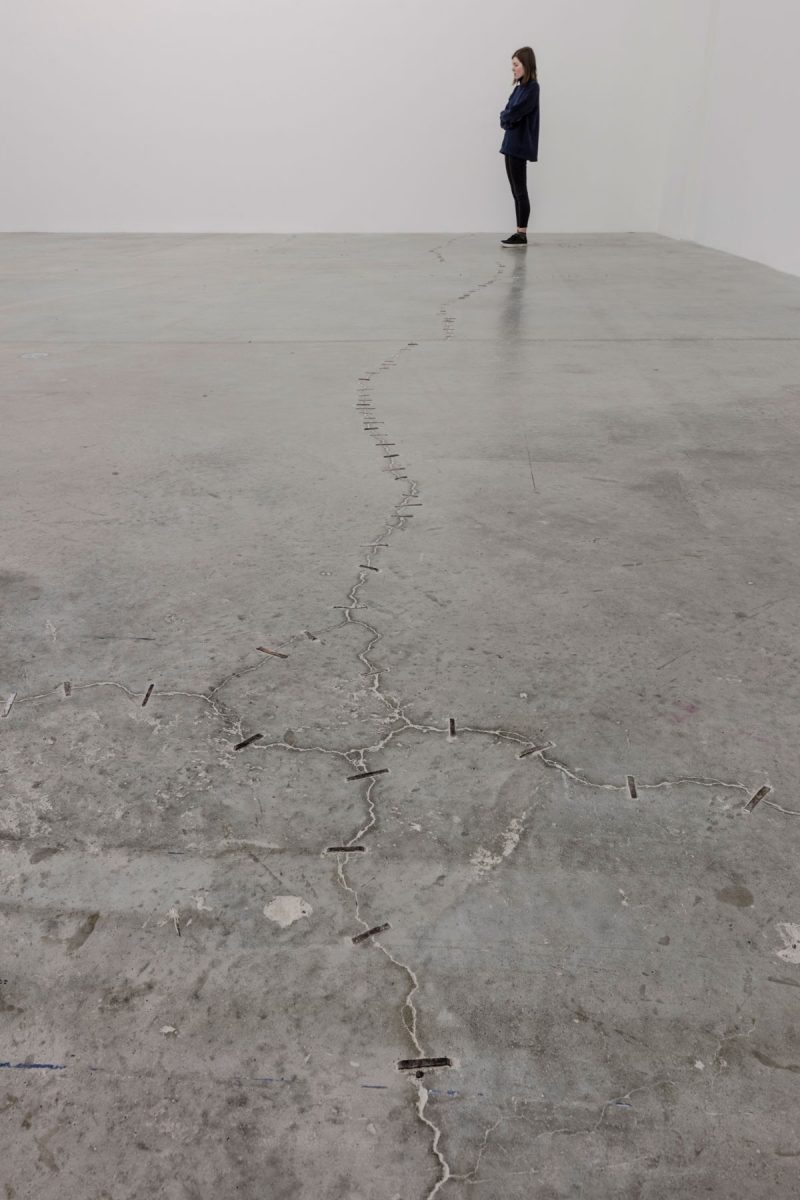

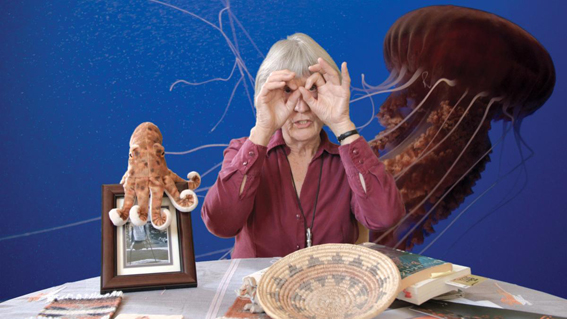

Linda Rocco defiende una educación que transforme la inteligencia artificial en aliada del pensamiento crítico y la autonomía intelectual.

En su teoría radical de la educación, publicada por primera vez en francés en 1987, Jacques Rancière distingue entre el progreso intelectual genuino y su falsificación institucional. Describe al «hombre de progreso» como «un hombre que avanza, que va a ver, que experimenta, que cambia su práctica, que comprueba su saber, y así sin final […] que erige esta opinión al rango de explicación dominante del orden social»1. Esta figura contrasta de forma llamativa con lo que Rancière denomina la «opinión del progreso», que presupone un punto de partida ya inscrito en las jerarquías establecidas: da por hecho que unos saben más y que otros deben alcanzarlos siguiendo su camino.

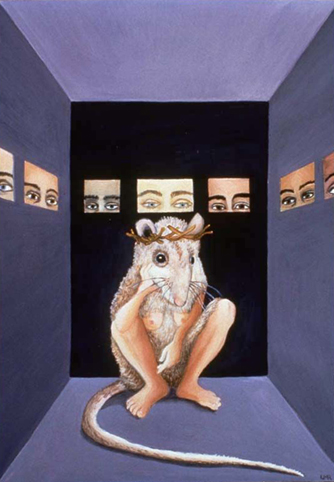

Mientras que el «hombre de progreso» verifica y experimenta sin atender al rango, la opinión del progreso refuerza el orden explicativo, definiendo el avance como transitar por una vía marcada por quienes se presumen más iluminados. La explicación —insiste Rancière— es la ficción de la pedagogía y el arma de quienes se dedican a la pedagogía. Crea una estructura de retraso y una distancia imaginaria entre mentes sabias e ignorantes, entre capaces e incapaces, reforzando así el lazo mismo del orden social y llevando a una estultificación impuesta, a saber, una anulación intelectual. Esta lógica subordina una inteligencia a otra, produciendo un círculo cerrado de poder que sostiene la jerarquía entre superiores e inferiores.

En los debates actuales sobre el uso de inteligencia artificial (IA) generativa en la educación superior, las opiniones polarizadas sobre el progreso oscilan entre un marco conservador neoludita que percibe la tecnología como una amenaza a las jerarquías de conocimiento establecidas y un entusiasmo tecnooptimista por cualquier novedad, como si por sí sola constituyera progreso. A lo largo de este espectro, mientras las instituciones europeas adoptan una postura más cautelosa y regulatoria, universidades en China, Singapur y Emiratos Árabes Unidos están siguiendo una senda marcadamente distinta. Casi un 60% del profesorado y alumnado universitario en China afirma usar herramientas de IA con frecuencia2; en Singapur, el 86% del estudiantado ya las utiliza en sus estudios3; y el estudiantado de Emiratos Árabes Unidos figuran entre los usuarios más frecuentes a nivel mundial, con un 32% empleando IA semanalmente4. Estas instituciones tratan la alfabetización en IA como una competencia que hay que dominar, no como un problema que deba gestionarse.

Pese a estas diferencias, persiste un riesgo fundamental: que la IA generativa en educación vacíe las mismas capacidades que dice cultivar. Estudios recientes5–6 muestran que la dependencia excesiva de la IA en entornos de aprendizaje reduce el pensamiento crítico y el compromiso cognitivo al externalizar cada vez más los procesos de razonamiento. En términos de Rancière, la IA generativa corre el riesgo de asumir el papel del explicador: una persona omnisciente, un «autómata del sí», que se erige en fuente de comprensión y refuerza la pasividad y la dependencia en lugar de fomentar la autonomía intelectual.

La crisis del aprendizaje

La tendencia de la IA generativa a comportarse como un autómata7 del sí se ve reforzada por su forma de eludir la causalidad, produciendo respuestas convincentes sin el razonamiento subyacente que exige un aprendizaje significativo. Basados principalmente en lógica estadística, estos sistemas destacan en hallar correlaciones, pero no comprenden el «porqué» de esas relaciones. Sin un anclaje causal, las explicaciones parecen fáciles de obtener, pero carecen de la estructura lógica que sostiene el aprendizaje genuino, lo que aumenta el riesgo de ser aceptadas sin verificación, incluso cuando son fabricadas o falsas. Esa facilidad constituye precisamente el peligro: elude el trabajo intelectual mediante el cual el estudiantado desarrolla los circuitos del razonamiento, el análisis crítico y el juicio independiente.

La esencia del aprendizaje reside en el esfuerzo intelectual y en el tiempo que requiere. Sin embargo, la promesa de la IA de ofrecer soluciones inmediatas y acceso fluido a la información derrumba la distancia reflexiva necesaria para un pensamiento profundo y una comprensión sólida. La erosión de esa dimensión temporal, imprescindible para que maduren los procesos de pensamiento, mina los cimientos de la indagación genuina y reduce la motivación de buscar comprensiones más hondas.

Se genera así una ironía profunda. Mientras las personas que se dedican al desarrollo entrenan a los sistemas de IA para realizar razonamientos humanos complejos, el estudiantado utiliza esas herramientas para desprofesionalizarse y evitar precisamente el trabajo intelectual que desarrolla tales capacidades de alto nivel. Surge entonces una crisis más amplia del aprendizaje: a medida que nuestras herramientas se vuelven más inteligentes, nuestra relación con el trabajo intelectual corre el riesgo de volverse más pasiva. Las tecnologías diseñadas para ampliar la inteligencia humana pueden estar socavando los procesos cognitivos mediante los cuales el aprendizaje, entendido como un compromiso transformador con el mundo, se convierte en crecimiento.

Si, como argumenta Rancière, la finalidad principal de la educación es la emancipación —«tomar la medida de la capacidad intelectual de alguien y decidir cómo usarla»8—, ¿qué enfoques pedagógicos y qué desarrollo de competencias pueden llevar a la emancipación en un panorama de educación superior donde coexisten múltiples formas de inteligencia y de aprendizaje en medio de una feroz competencia laboral?

El reto no es, en realidad, decidir si la IA debe usarse en la educación superior. Esa batalla no nos pertenece: la IA ya está transformando la manera en que el estudiantado piensa, escribe y aprende, y tratar de vigilarla es tan impráctico como inútil. La verdadera tarea consiste en determinar cómo integrar su uso en la enseñanza y el aprendizaje sin que se convierta en otro vector de estultificación, reforzando jerarquías del saber bajo el disfraz de la innovación, y en cambio hacerlo de un modo que amplíe las capacidades críticas y creativas.

Demasiado a menudo, la finalidad de la educación superior se ha reducido a producir resultados jerarquizados para la economía del conocimiento, con el éxito medido en métricas, objetivos de eficiencia y rankings. Esto se apoya en décadas de políticas neoliberales que han mercantilizado la educación, con especial influencia de las reformas inglesas de alcance global, que condujeron a una docencia desprofesionalizada y a resultados de aprendizaje estancados9. La IA acelera esta deriva, sacudiendo hasta el núcleo mismo las motivaciones para aprender. ¿Para qué sirve la educación? Cuando el estudiantado paga sumas considerables por su formación universitaria, ¿qué están comprando más allá de las credenciales? Esta reducción refleja lo que Gert Biesta denomina learnification10, algo así como laaprendificación —la reducción de la educación a mero aprendizaje, donde el foco se desplaza de los valores educativos a la simple adquisición de conocimientos, destrezas y competencias. La learnification convierte al estudiantado en consumidores de experiencias de aprendizaje, a la vez que oculta preguntas fundamentales sobre qué debe aprenderse, por qué importa y qué tipo de profesional se desea llegar a ser. Al ofrecer un acceso aparentemente fluido a la información y soluciones inmediatas a los problemas, la IA crea la ilusión de progreso educativo mientras evita los encuentros formativos con la dificultad, la incertidumbre y la alteridad que constituyen la experiencia educativa genuina.

Estas respuestas se complican aún más por la infraestructura digital en la que hoy opera la educación. Como observó Shoshana Zuboff11, las arquitecturas digitales ofrecen nuevas oportunidades de participación al tiempo que refuerzan las medidas de control y de mercantilización. Este patrón se ha intensificado conforme el capitalismo de la vigilancia ha ido evolucionando progresivamente hacia lo que Yanis Varoufakis12 describe como un giro hacia el tecnofeudalismo: un sistema en el que las plataformas no funcionan solo como participantes de mercado, sino como señores digitales de la nube, controlando tanto la infraestructura como la participación y extrayendo rentas de las huellas digitales de todos los que interactúan en sus dominios.

En el caso de las herramientas de IA educativa, esto crea una transacción sutil pero significativa: las mismas herramientas que ofrecen eficiencia, asistencia, aprendizaje personalizado y retroalimentación inmediata, también introducen patrones de monitorización conductual, extracción de datos y de trabajo, y dependencia de plataformas con consecuencias sociales y ambientales profundas, aunque externalizadas. Más fundamental aún: esto implica una transferencia de las infraestructuras del conocimiento desde instituciones públicas hacia plataformas comerciales privadas, en las que un saber antes accesible mediante sistemas públicos pasa a mediarse a través de servicios de IA propietarios. Esta privatización reconfigura al mismo tiempo cómo se construye el conocimiento, ya que el filtrado de la información mediante lógicas algorítmicas conduce a un progresivo reduccionismo epistemológico. A su vez, esta estructuración invisible del acceso y del compromiso altera la agencia personal y la autonomía.

Verificación y dominio

La provocación central de Rancière —que debemos partir de la igualdad de las inteligencias y sostenerla a través de la verificación— es especialmente urgente. Para él, la emancipación no es un destino, sino una práctica de autoverificación e indagación, en la que la voluntad y la atención impulsan el aprendizaje genuino en lugar de un consumo pasivo de explicaciones. En el contexto del aprendizaje asistido por IA, este marco resulta particularmente vital. Dadas las limitaciones de la IA generativa en cuanto al razonamiento causal, el acto de verificar deja de ser un ideal pedagógico para convertirse en una necesidad práctica. El estudiantado debe aprender a interrogar las salidas de la IA, contrastar afirmaciones y comprometerse con el tipo de investigación crítica que la IA no puede realizar. En lugar de aceptar la IA como el nuevo explicador —la fuente mecánica de una comprensión prefabricada—, la educación emancipadora exige usar la IA como material para el trabajo intelectual, no como sustituto de este. La voluntad y la atención del estudiante se tornan aún más cruciales cuando la tentación de externalizar el pensamiento está tan fácilmente al alcance.

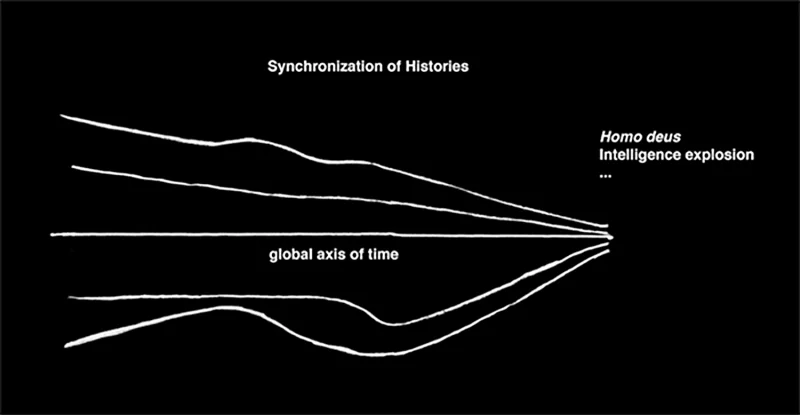

Estos desafíos pedagógicos se ven reforzados por la aceleración de los flujos de información y las temporalidades fracturadas moldeadas por los teléfonos inteligentes y las redes sociales. Como advirtió Walter Benjamin13, la crítica del progreso debe abordar no solo sus fines, sino también su ritmo y su cadencia. Paul Virilio14, más tarde, teorizó la velocidad como la fuerza primaria que impulsa la civilización moderna, argumentando que la aceleración comprime el tiempo disponible para la reflexión y la toma de decisiones. Este imperativo de velocidad impulsa el diseño de las plataformas digitales, cuyos algoritmos optimizan los flujos de contenidos cultivando hábitos de escaneo rápido y de compromiso superficial. Aplicado al contexto educativo, semejante aceleración puede clausurar la reflexión, oscurecer alternativas y estrechar el espacio para la verificación. Años de interacción con estos sistemas han acortado la capacidad de atención, normalizado la fragmentación cognitiva y vuelto cada vez más rara la disciplina de destinar tiempo deliberado a la indagación sostenida.

En este contexto, la IA representa a la vez la mayor amenaza a la emancipación intelectual y, paradójicamente, un catalizador particularmente urgente.

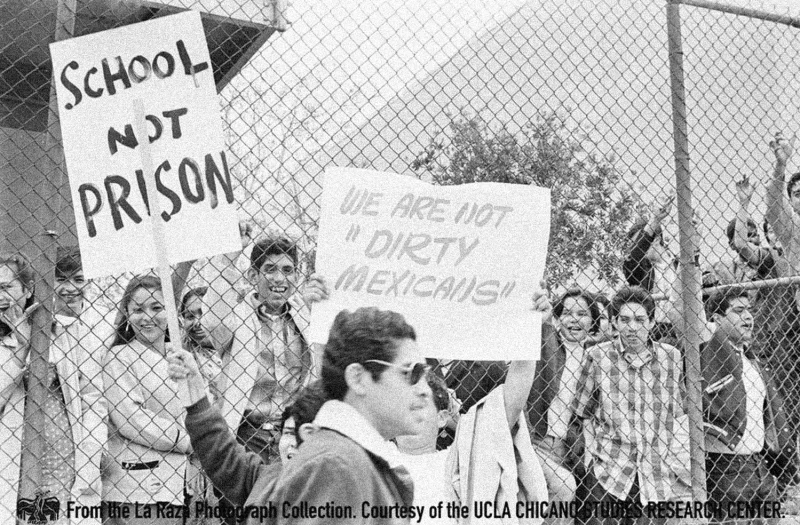

La necesidad de un compromiso crítico cobra renovado impulso si consideramos cómo ya ha sido transformado el aprendizaje por los medios en red. Desde hace años, el estudiantado recurren a comunidades de Reddit, tutoriales de YouTube, foros en línea y podcasts en los que a menudo encuentran mayor implicación que en las aulas tradicionales. Este paisaje mediático distribuido ha difuminado radicalmente la división de Rancière entre productores y consumidores del conocimiento, un cambio que Alvin Toffler anticipó en La tercera ola (1980) al predecir que en la era posindustrial los roles de productor y consumidor se fundirían en la figura del «prosumidor». Esta noción describe cómo todas las personas participamos hoy en los medios en red —y ahora neuronales—: consumiendo contenidos mientras producimos respuestas, análisis e ideas mediante comentarios, publicaciones e interacciones algorítmicas, como forma de producción situada de conocimiento. Este fenómeno demuestra que la igualdad intelectual no es solo un ideal filosófico, sino una práctica activa en muchos rincones de internet, a menudo en «bosques oscuros»15 que prosperan fuera de las plataformas más comerciales. Allí, el conocimiento se entiende como contingente y relacional.

La IA generativa irrumpe ahora en este paisaje con el potencial de profundizar en estas prácticas de igualdad intelectual o de erosionarlas, reinstaurando la jerarquía del explicador y reduciendo a las personas participantes activas a receptoras pasivas. Esto supone tanto una extensión como una intensificación de tendencias ya existentes: así como el estudiantado aprendió a navegar el vasto e incierto paisaje informativo de internet —desarrollando habilidades para distinguir fuentes fiables de la desinformación y para sintetizar perspectivas diversas—, ahora deben cultivar competencias paralelas con la IA. La diferencia es que la sofisticación de la IA eleva las apuestas y hace aún más urgente el compromiso crítico.

Más allá de la especulación tecnooptimista, no puede ignorarse la realidad económica de la alfabetización en IA como moneda profesional, lo que abre oportunidades para un muy necesario compromiso desde las artes y las humanidades. A nivel global, aproximadamente el 86% del estudiantado utiliza ya herramientas de IA con regularidad en su aprendizaje16, lo que hace que evitarlas sea cada vez menos práctico. En el Reino Unido, pese a las dudas sobre si el entusiasmo actual del mercado refleja tendencias sostenibles o una moda pasajera, la demanda de competencias en IA ha crecido, con un aumento del 21% en las ofertas de empleo y una prima salarial del 23% vinculada a dichas competencias, superior a la de los títulos formales hasta nivel de doctorado17. En este contexto, la verdadera autonomía y emancipación requieren no rechazo, sino dominio: la capacidad de navegar críticamente y con creatividad por las herramientas de IA, en lugar de ser utilizados por ellas. Esto implica comprender tanto su potencial como sus limitaciones, interrogar sus resultados y usos, y mantener la autonomía crítica que impida que la dependencia tecnológica se convierta en subordinación intelectual.

Esta necesidad de dominio se extiende también al profesorado. Aunque el paradigma vertical de la enseñanza magistral y la autoridad pedagógica que Rancière criticaba ya mostraba fisuras antes de su intervención, la IA amenaza ahora la misma posibilidad de una enseñanza universal que Jacotot defendía. En lo que respecta a la IA, no podemos, en realidad, seguir el ejemplo de Jacotot de enseñar una lengua sin conocerla. La tecnología necesita ser desmitificada e intervenida críticamente; no puede abordarse desde una posición de ignorancia deliberada.

A diferencia de Jacotot, que podía guiar a sus estudiantes a través del Telémaco sin hablar él mismo neerlandés, quienes actualmente se dedican a la docencia no pueden orientar de forma eficaz al estudiantado hacia una alfabetización crítica en IA sin comprometerse directamente con estas herramientas: deben probar los sistemas de IA, explorar sus limitaciones, comprender sus sesgos y experimentar de primera mano tanto sus capacidades como sus fallos. Esto no supone una traición a los principios de Rancière, sino su aplicación práctica: el profesorado no necesita ser experto en IA, pero sí explorador, capaz de aproximarse a estas herramientas con el mismo espíritu de indagación y verificación que aspira a cultivar en sus estudiantes. Comprender las capacidades y los puntos ciegos de la IA se vuelve esencial para esta práctica exploratoria: saber dónde estas herramientas destacan y dónde fracasan inevitablemente, a la vez que se desarrolla una conciencia crítica de sus implicaciones ontológicas, epistemológicas, políticas, económicas y medioambientales.

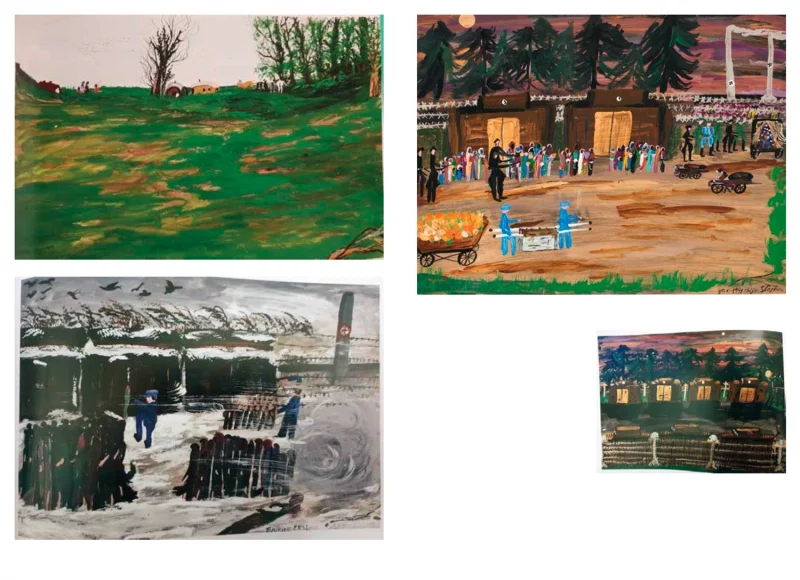

Más ampliamente, resulta urgente que investigadores y profesionales de las artes y las humanidades se involucren directamente en el desarrollo de la IA, aportando las perspectivas críticas necesarias para ampliar sus supuestos de base, en lugar de dejar su diseño exclusivamente en manos de informáticos e ingenieros. A medida que la IA redistribuye constantemente la información y la legitimidad intelectual, y que el estudiantado se vuelva más conectado globalmente y más alfabetizado digitalmente, el papel del docente debe ser reconfigurado.

Si quienes se dedican a la docencia se retiran de la IA por miedo o por principios, abdican de su responsabilidad de ayudar al estudiantado a desarrollar relaciones críticas con estas herramientas. Este retraso institucional recrea, paradójicamente, la estructura de demora de Rancière: no el aplazamiento artificial del orden explicativo, sino una brecha temporal que genera nuevas jerarquías de «velocidad», en las que algunos navegan por las complejidades de la IA en solitario, reforzando potencialmente la misma dependencia y subordinación intelectual que la educación emancipadora busca evitar.

Pedagogía emancipadora en la práctica

En este nuevo ecosistema, donde el conocimiento circula entre estudiantes, docentes y diversas formas de inteligencia, la autoridad se distribuye. El monopolio de la producción de sentido ha quedado roto y requiere esfuerzos colaborativos para reconfigurar algunas verdades fundamentales sobre el aprendizaje.

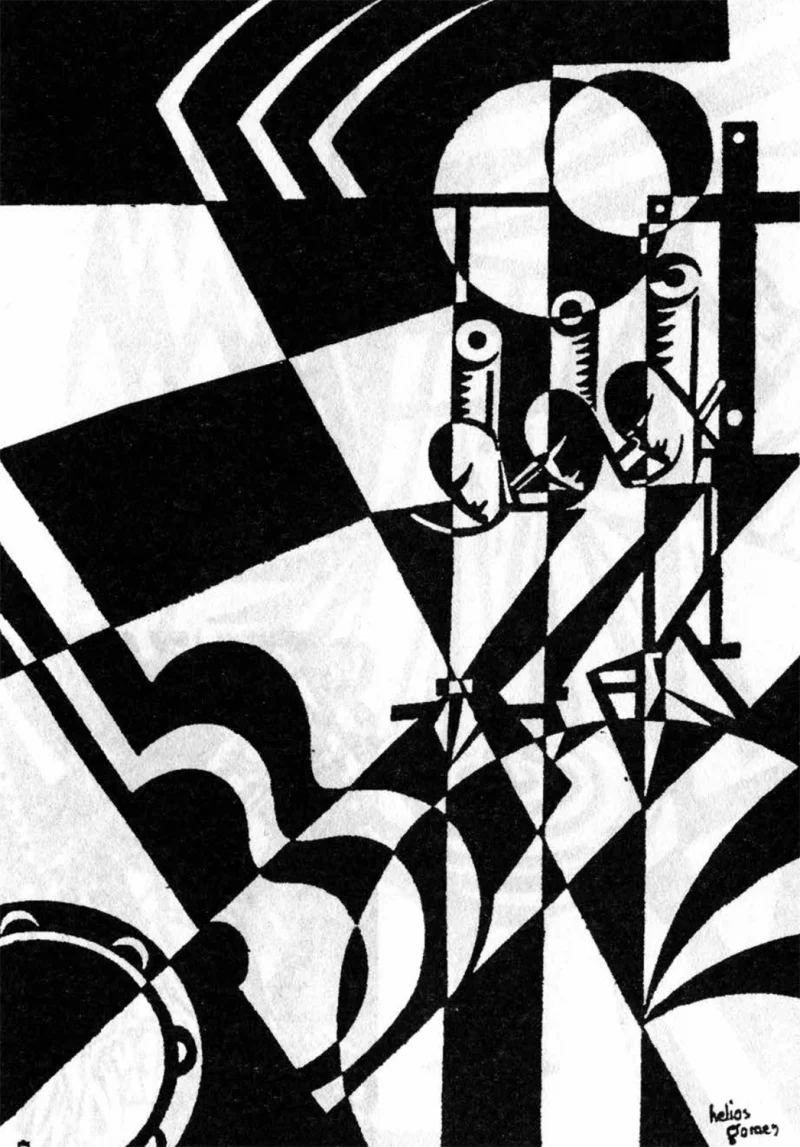

Si la educación superior quiere responder de manera significativa a estas condiciones transformadas, debe adoptar nuevos métodos pedagógicos: no un método basado en el conocimiento superior, sino en la coindagación, la verificación y la búsqueda intelectual. En lugar de enfoques explicativos, la pedagogía emancipadora requiere un método que surja de la negociación y la interacción, uno que desarrolle capacidades intelectuales que no pueden automatizarse fácilmente, como la habilidad de sostener una indagación prolongada, colaborar con inteligencias humanas y no humanas, y adaptar el pensamiento a medida que cambian las circunstancias. Esto es, en esencia, lo que asegura la inversión del estudiantado: acceso a comunidades de práctica en las que se comprometen con otras que afrontan desafíos intelectuales similares, no solo como consumidores individuales de conocimiento, sino como miembros de un espacio social y democrático compartido, donde la agencia colectiva emerge mediante la indagación negociada, junto con el tiempo y la orientación necesarios para estructurar el desarrollo intelectual y la independencia crítica. Este enfoque honra la visión de Rancière del «espíritu como actividad», en la que «la inteligencia es atención y búsqueda antes de ser combinación de ideas»18.

Esto requiere crear espacios de coaprendizaje con el estudiantado mientras se desarrollan patrones que fomenten una implicación crítica y productiva. El profesorado debe cultivar la conciencia metacognitiva y ética del estudiantado acerca de cómo funcionan estos sistemas, proporcionando marcos críticos que permitan cuestionar las fuentes, los supuestos y las implicaciones del contenido generado por IA. La autoridad del docente se transforma en la de un interventor crítico: alguien que interviene en la interacción IA-estudiante para introducir cuestionamientos críticos, modelando la humildad intelectual y, al mismo tiempo, empoderando a quienes están en el proceso de aprendizaje para discernir, cuestionar y deconstruir las afirmaciones generadas por la máquina.

El docente contemporáneo afronta un doble imperativo: dotar al estudiantado de la capacidad de interrogar críticamente los resultados de la IA y modelar, en su propia práctica, un compromiso ético y reflexivo con la tecnología. El objetivo no es enseñar al estudiantado qué pensar sobre la IA, sino enseñarles a pensar de manera independiente: aprender haciendo y, si así lo desean, usar estas herramientas para expandir —y no reemplazar— su pensamiento. Esto implica acercar la adquisición de conocimiento a su aplicación, garantizando que el estudiantado se enfrente al saber y trabaje con él en contextos en los que deban verificarlo, cuestionarlo y aplicarlo, estableciendo conexiones personales que le den sentido.

En última instancia, este enfoque enfatiza la colaboración por encima del control, la curiosidad por encima de la obediencia. Anima al estudiantado a explorar sus intereses, a investigar meticulosamente, a seguir sus impulsos intelectuales y agudizar su pensamiento, utilizando la IA como herramienta de descubrimiento y no como muleta para evitar el esfuerzo. Tales prácticas cultivan la resiliencia intelectual necesaria para los inevitables cambios tecnosociales que se avecinan.

El mundo en el que nosotras, aquellas personas que nos dedicamos a la docencia, crecimos, ya no existe, ni tampoco las suposiciones que sustentaban nuestro aprendizaje. En este paisaje transformado, tenemos la responsabilidad de modelar el mismo coraje intelectual y el mismo compromiso crítico que buscamos cultivar en nuestro estudiantado. Este momento exige reconfigurar la educación en torno al reto urgente de practicar la agencia y perseguir la emancipación en una era en la que el conocimiento abunda y la inteligencia está en disputa.

Notas bibliográficas:

- Rancière, Jacques: El maestro ignorante. Cinco lecciones sobre la emancipación, Editorial Laertes, Barcelona, 2003, p. 64. ↩︎

- Chen, Caiwei: « Chinese universities want students to use more AI, not les», MIT Technology Review, 28 de julio de 2025. En línea en: https://www.technologyreview.com/2025/07/28/1120747/chinese-universities-ai-use/ [Última consulta realizada el 9 de septiembre de 2025]. ↩︎

- Véase el informe «Digital Education Council Global AI Student Survey 2024», Digital Education Council, 2 de agosto de 2024. En línea en: https://www.digitaleducationcouncil.com/post/digital-education-council-global-ai-student-survey-2024 [Última consulta realizada el 9 de septiembre de 2025]. ↩︎

- Véase el artículo «Anthology Survey Reveals Enthusiastic Approval of AI in UAE Universities», Anthology, 2 de noviembre de 2023. En línea en: https://www.anthology.com/news/anthology-survey-reveals-enthusiastic-approval-of-ai-in-uae-universities [Última consulta realizada el 9 de septiembre de 2025]. ↩︎

- Gerlich, Michael: «AI Tools in Society: Impacts on Cognitive Offloading and the Future of Critical Thinking», Societies, vol. 15, n. º 1, 2025, p. 6. En línea en: https://doi.org/10.3390/soc15010006 [Última consulta realizada el 9 de septiembre de 2025]. ↩︎

- Kosmyna, Nataliya et al.: «Your Brain on ChatGPT: Accumulation of Cognitive Debt when Using an AI Assistant for Essay Writing Task», arXiv, 2025. En línea en: https://arxiv.org/abs/2506.08872 [Última consulta realizada el 9 de septiembre de 2025]. ↩︎

- N. de la E. En el texto original en inglés, la autora utiliza la expresión yes-man, que en inglés enfatiza tanto la automatización como la obediencia servil asociada a lo masculino —yes-man significa literalmente «hombre que siempre dice que sí», una figura subordinada y complaciente ante la autoridad—. Al traducirse como autómata del sí, se mantiene la idea de una máquina obediente, aunque se pierde parcialmente la carga de género presente en el original, que contrasta deliberadamente con los asistentes virtuales feminizados —como Alexa, Siri o Cortana—. Este matiz subraya cómo las proyecciones de género en la inteligencia artificial reflejan jerarquías culturales y simbólicas en torno a la voz, la obediencia y la autoridad. ↩︎

- Rancière, Jacques: Óp. cit., p. 17. ↩︎

- Ball, Stephen J.: The Education Debate: Policy and Politics in the Twenty-First Century, Policy Press, Bristol, 2017. ↩︎

- Biesta, Gert J. J.: Good Education in an Age of Measurement: Ethics, Politics, Democracy, Paradigm Publishers, Boulder, CO, 2010. ↩︎

- Zuboff, Shoshana: The Age of Surveillance Capitalism: The Fight for a Human Future at the New Frontier of Power, PublicAffairs, Nueva York, 2019. ↩︎

- Varoufakis, Yanis: Technofeudalism: What Killed Capitalism, Bodley Head, Londres, 2023. ↩︎

- Benjamin, Walter: «Theses on the Philosophy of History» (1940), en Arendt, Hannah: Illuminations, Schocken Books, Nueva York, 1968, pp. 253-264. ↩︎

- Virilio, Paul: Speed and Politics (trad. Mark Polizzotti), Semiotext(e), Nueva York, 1986. ↩︎

- Strickler, Yancey: «The Dark Forest Theory of the Internet», The Ideaspace, mayo de 2019. En línea en: https://www.ystrickler.com/the-dark-forest-theory-of-the-internet/ [Última consulta realizada el 9 de septiembre de 2025]. ↩︎

- Kelly, Rhea: «Survey: 86% of Students Already Use AI in Their Studies», Campus Technology, 28 de agosto de 2024. En línea en: https://campustechnology.com/articles/2024/08/28/survey-86-of-students-already-use-ai-in-their-studies.aspx [Última consulta realizada el 9 de septiembre de 2025]. ↩︎

- Gonzalez Ehlinger, Eugenia y Stephany, Fabian: «Skills or Degree? The Rise of Skill-Based Hiring for AI and Green Jobs», SSRN Electronic Journal, 25 de febrero de 2024. En línea en: https://doi.org/10.2139/ssrn.4603764 [Última consulta realizada el 9 de septiembre de 2025]. ↩︎

- Rancière, Jacques: Óp. cit., p. 32. ↩︎